¿Por qué las cosas generadas por IA siempre parecen ser más de lo mismo?

La impresión cuando vemos algo generado por inteligencia artificial es que lo hemos visto antes. Esto sucede por algo que está detrás de casi todas las herramientas actuales.

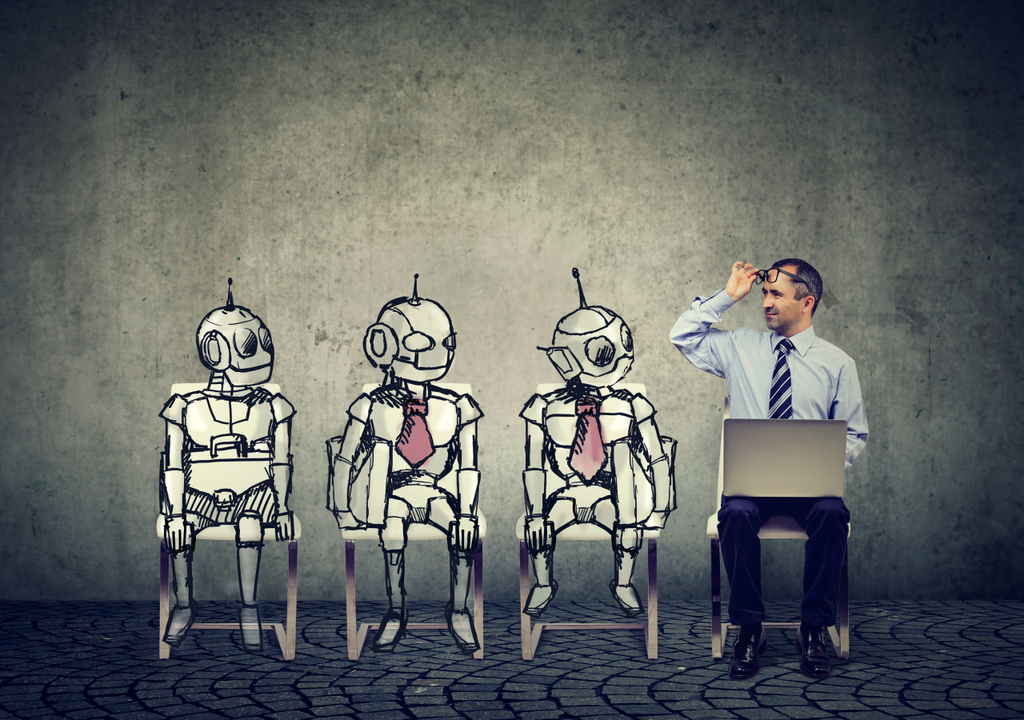

Cuando miras algo creado por inteligencia artificial, ya sea una imagen o un texto, la impresión es que ya lo has visto antes. Las imágenes no parecen originales y los textos se parecen a otros textos. La falta de creatividad en las cosas generadas por la inteligencia artificial es un debate constante en las redes sociales y en los artículos.

La razón de esta impresión es el pilar mismo de cómo se crean estas herramientas y cómo se entrenan. El aprendizaje de máquina —o machine learning— es el secreto detrás de casi todos los modelos actuales y al mismo tiempo conlleva una limitación en los resultados. Durante el aprendizaje automático, el modelo aprende observando patrones en los datos que ha recibido.

Debido a que los datos que se ingresan generalmente fueron creados por humanos, el modelo solo puede aprender patrones y relaciones entre cosas que ya existen. Recientemente, ha crecido una discusión sobre el uso de datos de artistas y se han planteado puntos importantes. La discusión muestra que el uso del aprendizaje automático en la inteligencia artificial generativa puede ser el problema detrás de estas cuestiones.

IA x IA Generativa

Desde que ChatGPT ganó popularidad, la inteligencia artificial generativa ha sido el tema más debatido dentro de la comunidad de inteligencia artificial. De hecho, las grandes empresas tecnológicas han centrado recursos e inversiones en el área de la inteligencia artificial generativa. Su popularidad ha llegado a ser tan grande que es común que se confundan inteligencia artificial e inteligencia artificial generativa.

Dentro de la inteligencia artificial existen otras áreas como la predictiva, de clasificación, de regresión y otras. Cada área tiene objetivos diferentes, y la parte de generación de datos, incluida en la generativa, es sólo una de varias aplicaciones. Recientemente, el potencial de la generatividad ha aumentado considerablemente con la introducción de las transformers.

Aprendizaje de máquina

Algo común en casi todos los ámbitos es el uso del aprendizaje de máquina. El aprendizaje de máquina se refiere a un conjunto de técnicas que una máquina aprende mediante la observación de patrones. La idea es alimentar una gran cantidad de datos a un modelo que aprenderá a identificar patrones y relaciones entre los datos.

Hay dos tipos comunes de aprendizaje: el supervisado y el no supervisado. Supervisado se refiere a cuando hay una entrada y una salida con la respuesta, la máquina aprende la relación entre la entrada y la salida a través de una función. No supervisado se refiere a cuando la máquina recibe datos de entrada y aprende relaciones por sí sola.

¿Cómo aprende la inteligencia artificial generativa?

En el caso de la inteligencia artificial puede producirse una combinación de ambos tipos de aprendizaje e incluso el llamado aprendizaje semisupervisado. Algunas técnicas de aprendizaje de inteligencia artificial generativa se basan en observar patrones y reconstruirlos, como los rostros humanos. Una de esas técnicas son las redes neuronales generativas (GAN).

En 2017, Google introdujo capas de atención junto con las transformers. La idea es que durante esta observación de patrones, se utilicen capas de atención para priorizar regiones importantes en una imagen o texto. Algunos tipos de transformers aprenden mediante supervisión como algunos tipos de traductores, mientras que otros pueden presentar una combinación de métodos.

¿Por qué todo parece más de lo mismo?

Como el aprendizaje de máquina es la técnica más utilizada en las herramientas actuales, aprenden a través de datos preexistentes. Textos, imágenes, vídeos que ya hayan visto durante el proceso de formación. Con esto, estos modelos aprenden patrones que ya conocen y los relacionan para crear algo.

Al estar basados en estos patrones conocidos, es natural que las cosas generadas por la inteligencia artificial no parezcan originales. Esta es una crítica constante de muchas personas y la razón es que el método de aprendizaje en sí limita la creación de cosas nuevas. Actualmente sólo es posible crear y establecer relaciones con cosas existentes.

Controversia

Una de las principales críticas es el tema de los derechos de autor ya que muchas de estas herramientas se entrenan y aprenden de datos obtenidos en internet. Estos datos suelen provenir de obras de arte realizadas por artistas que se utilizarán como modelo para reproducir el estilo de ese artista. De esta manera, la herramienta no crearía algo y simplemente copiaría el estilo.

Esto también está relacionado con la limitación de que las herramientas no pueden crear algo original y, a menudo, el estilo es una copia de los artistas. Otro punto es que sin el arte humano, estas herramientas llegan a un límite ya que no son capaces de crear algo nuevo.